近日,第14届国际表征学习大会(ICLR 2026)论文录用结果揭晓。学院基于人工智能和区块链技术的超大型数字创意平台创新团队再传喜讯,两项最新研究成果成功入选:《PMDformer: Patch-Mean Decoupling Information Transformer for Long-term Forecasting》(共同第一作者:研究生胡澳与段江教授,通讯作者:温良剑副教授)和《Web-CogReasoner: Towards Knowledge-Induced Cognitive Reasoning for Web Agents》(共同第一作者:研究生郭聪,通讯作者:温良剑副教授)。两篇论文一作单位都是西南财经大学,属于西南财经大学在ICLR发表的前两篇篇论文。

ICLR(International Conference on Learning Representations,国际表征学习大会)是深度学习领域享誉全球的顶级学术会议,聚焦于人工智能、统计与数据科学以及机器视觉、文本理解等重要应用方向的前沿研究,是全球增长最快的人工智能会议之一。ICLR 2026是该系列会议的第14届,本届大会共收到有效投稿19,631篇,最终录用论文5,343篇,总体录用率约为26.97%。在2026年3月中国计算机学会(CCF)正式通过的第七版推荐目录中,ICLR首次被正式收录并直接定级为CCF-A类会议。

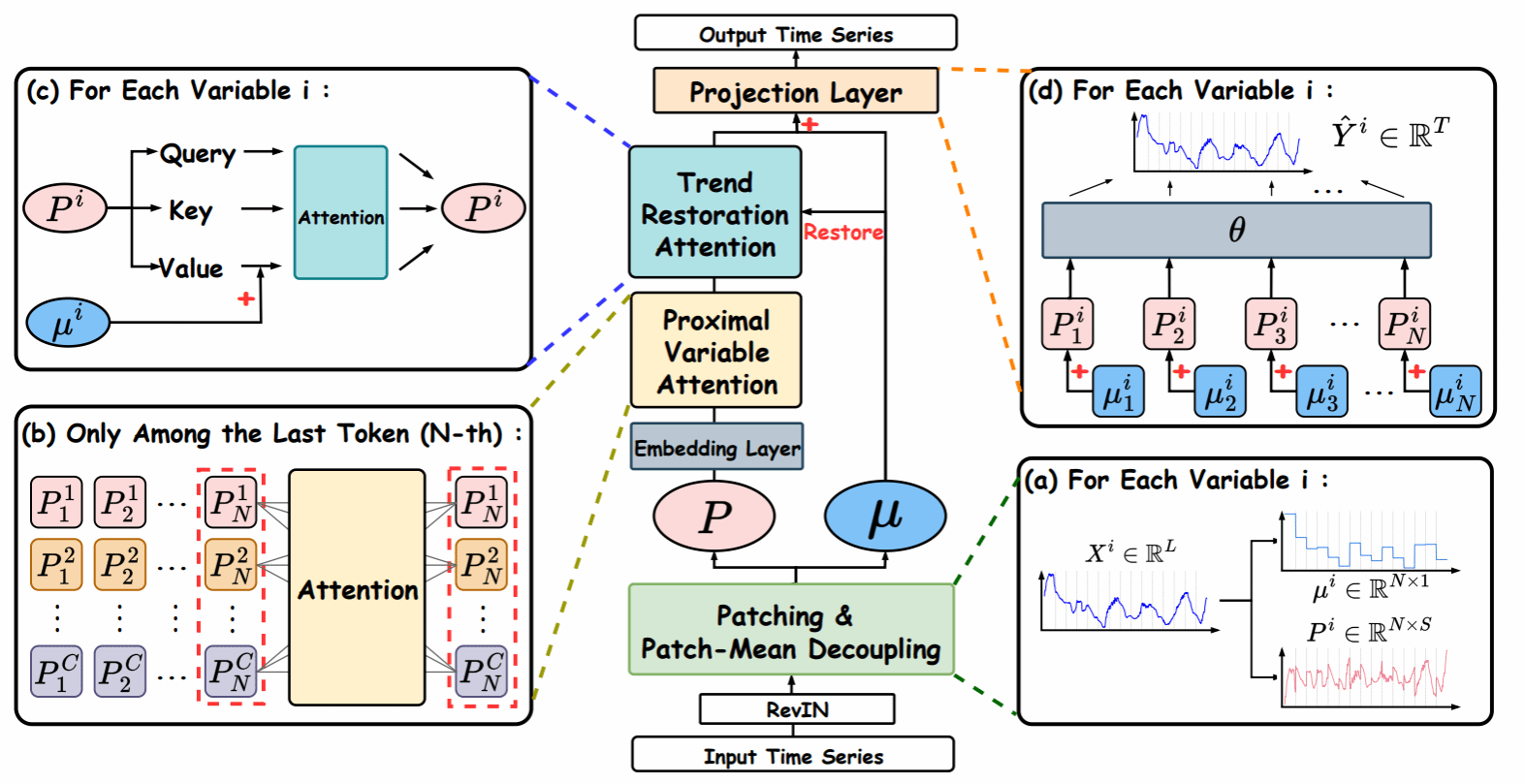

研究成果一:PMDformer: Patch-Mean Decoupling Information Transformer for Long-term Forecasting

论文概述:长期时序预测是金融、能源、气象等关键领域的核心任务。现有基于Transformer的主流方法普遍采用Patch机制对时间序列进行分块处理,其核心思路在于通过注意力机制捕获不同Patch之间以及不同变量之间的形状相似性,以此发掘蕴含在序列中的规律性信息。然而,真实世界的时间序列往往具有非平稳性,不同Patch之间存在显著的尺度差异,这使得注意力机制难以聚焦于真正反映序列内在结构的形状相似性,从而干扰了模型对有效时序模式的学习,制约了预测精度的进一步提升。针对上述问题,该研究提出了PMDformer,其核心设计是在送入注意力计算前,将每个Patch中代表趋势的尺度因子显式分离出来,使注意力机制得以专注于建模去除尺度干扰后的纯粹形状相似性,从根本上缓解了非平稳性对相似度计算的负面影响。与此同时,研究团队进一步提出了趋势恢复注意力模块,该模块在不干扰形状相似性捕获的前提下,专门负责对分离出的尺度趋势信息进行充分建模与恢复,从而实现形状相似性学习与趋势动态建模的协同互补。在多个标准长期预测基准数据集上的实验结果表明,PMDformer以较低的计算开销实现了超越现有最优方法的预测精度。

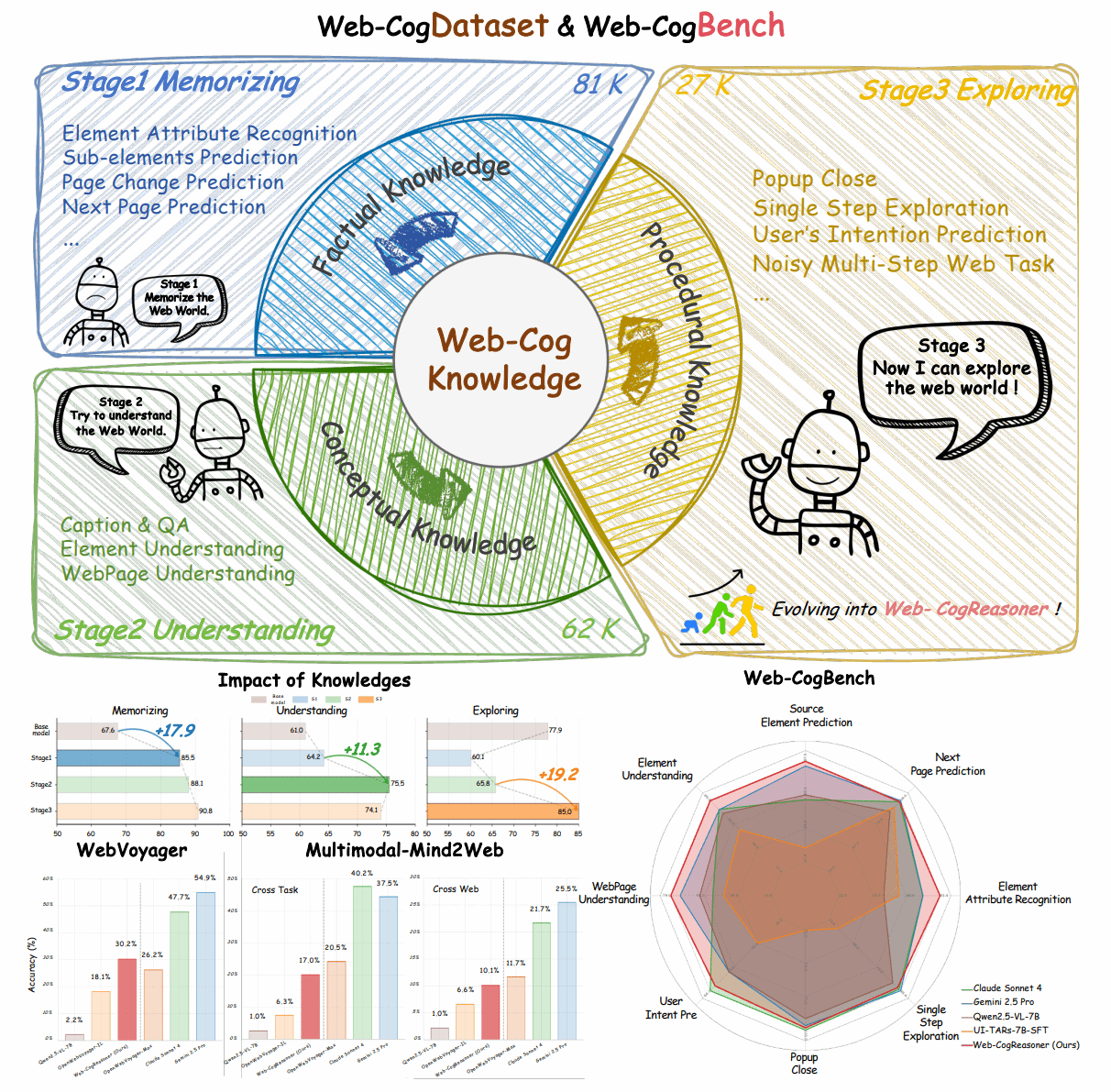

研究成果二:Web-cogreasoner: Towards knowledge-induced cognitive reasoning for web agents

论文概述:随着多模态大模型的快速发展,Web智能体在自动化完成网页操作与复杂任务方面展现出巨大潜力。然而,现有Web智能体大多聚焦于提升感知与操作能力,缺乏系统化的知识体系作为认知推理的支撑,导致在面对陌生复杂任务时泛化能力有限,推理过程也缺乏可解释性。为此,该研究提出了Web-CogKnowledge Framework。受布鲁姆教育分类法启发,该框架将Web智能体所需的认知能力系统地拆解为知识学习与认知推理两个核心阶段,并将知识类型细分为事实性知识(Factual)、概念性知识(Conceptual)与程序性知识(Procedural)三个层次,构建起结构清晰的知识体系。在此框架基础上,研究团队进一步提出了Web-CogReasoner智能体,其核心推理机制为知识驱动的思维链(Knowledge-driven Chain-of-Thought, CoT):每一推理步骤均显式锚定于特定类型的知识,使智能体的决策过程兼具目标导向性与可解释性。为支撑模型的训练与评估,团队从14个真实网站采集多模态数据,构建了涵盖12类任务的层次化数据集Web-CogDataset,并设计了专用评测基准Web-CogBench。实验结果表明,Web-CogReasoner在标准任务上的表现显著优于现有方法,在泛化至未见任务的场景中更是展现出突出优势。