近日,第39届神经信息处理系统大会NeurIPS 2025论文录用结果揭晓,基于人工智能和区块链技术的超大型数字创意平台创新团队的最新研究成果《InfMasking: Unleashing Synergistic Information by Contrastive Multimodal Interactions》(共同第一作者:温良剑和本科生戴群,通讯作者: 段江教授)和通用人工智能与数字经济创新团队关于大模型轻量化的最新研究成果《LoTA-QAF: Lossless Ternary Adaptation for Quantization-Aware Fine-Tuning》(第一作者:研究生陈俊宇,通讯作者:施龙副教授)被录用。其中,《InfMasking: Unleashing Synergistic Information by Contrastive Multimodal Interactions》被NeurIPS 2025评选为Spotlight论文(总提交21575篇,接收5290篇,其中688篇被选为Spotlight),属于西南财经大学在NeurIPS发表的第一篇Spotlight论文。

Conference on Neural Information Processing Systems(NeurIPS)创立于1987年,是人工智能和机器学习领域最具影响力的国际顶级会议之一,被中国计算机学会(CCF)推荐为 A类会议。近年来,NeurIPS 论文提交量屡创新高,录用率常年维持在 20%~26% 左右。NeurIPS 2025将于2025年12月2日至7日在美国圣地亚哥举办,本次会议共收到21575份有效投稿,共接收5290篇,录取率为24.52%。

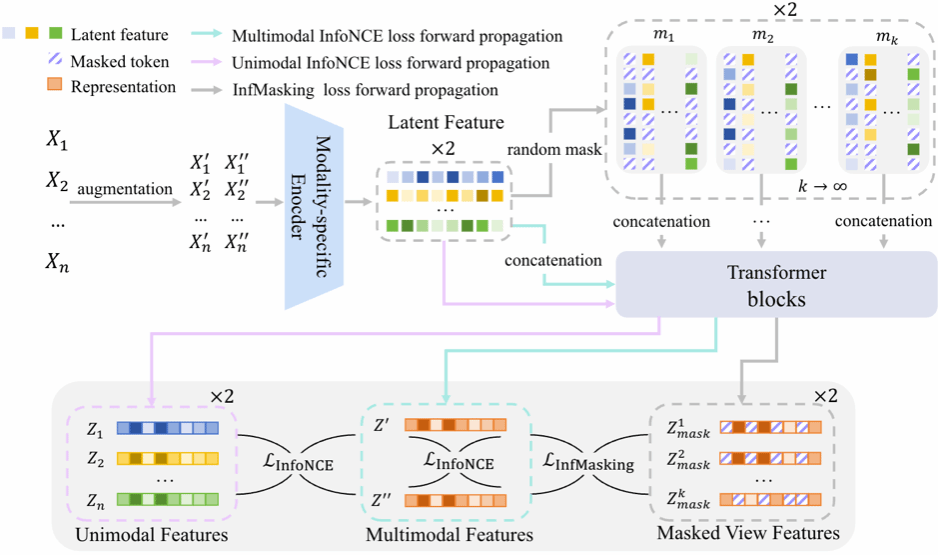

研究成果一:InfMasking: Unleashing Synergistic Information by Contrastive Multimodal Interactions

论文概述:在多模态表示学习中,模态之间的协同交互不仅提供互补信息,还通过特定交互模式创造出单一模态无法单独实现的独特结果。现有的方法可能难以有效捕捉协同信息的完整谱系,从而导致在这些交互至关重要的任务中性能次优。这一点尤为棘手,因为协同信息构成了多模态表示的核心价值主张。为了应对这一挑战,我们引入了InfMasking,这是一种对比式协同信息提取方法,通过无限掩码策略来增强协同信息。InfMasking在融合过程中随机遮蔽每个模态的大部分特征,仅保留部分信息,从而创建出具有多样协同模式的表示。然后,通过互信息最大化将未掩码的融合表示与掩码表示对齐,以编码全面的协同信息。这种无限掩码策略通过在训练过程中将模型暴露于多样化的部分模态组合,从而实现捕捉更丰富的交互。由于使用无限掩码计算互信息估计在计算上过于昂贵,我们推导出了InfMasking损失函数来近似这一计算。通过控制实验,我们证明InfMasking有效增强了模态之间的协同信息。在大规模真实世界数据集上的评估中,InfMasking在七个基准测试上达到了最先进的性能。

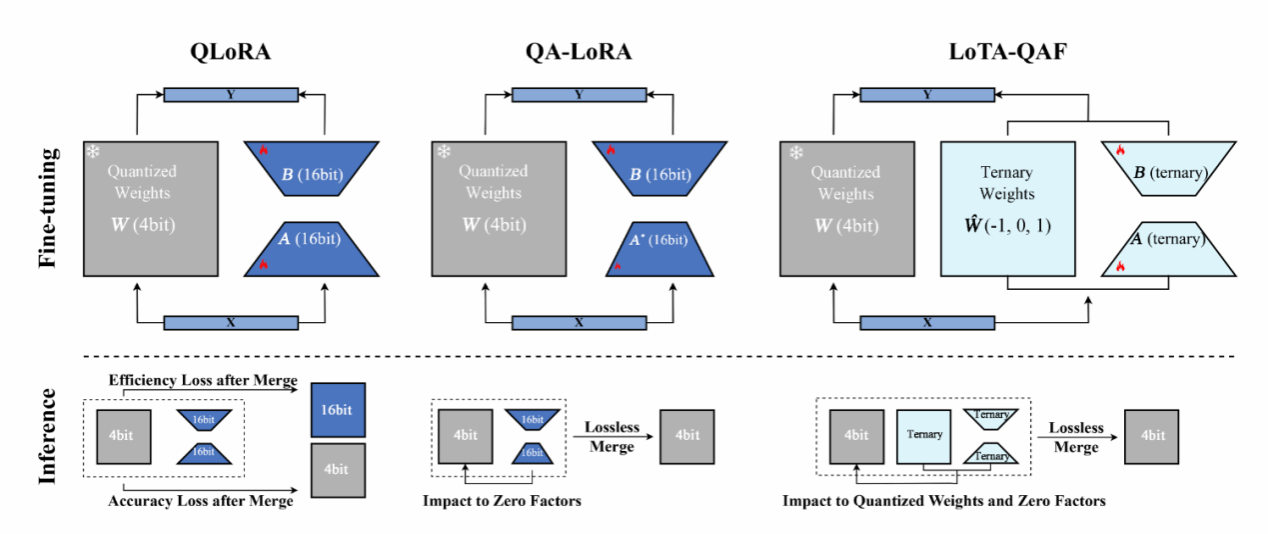

研究成果二:LoTA-QAF: Lossless Ternary Adaptation for Quantization-Aware Fine-Tuning

论文概述:LoTA-QAF,一个旨在实现极致推理效率的量化模型微调框架。通过新颖的三值适配技术,在微调后可将适配器无损地并入量化模型权重,实现与原始量化模型完全一致的低比特推理路径。相比于QLoRA等需要混合精度计算的方法,LoTA-QAF在推理时无任何额外计算开销,速度提升可达1.7-2.0倍 。同时,通过直接调整全部量化权重 ,它在性能恢复任务上超越了16位LoRA ,真正做到了不牺牲效率,更能提升量化后的微调性能。